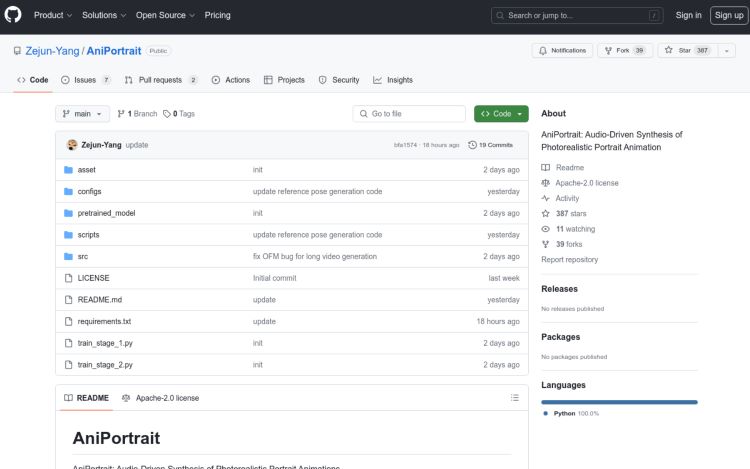

AniPortrait——腾讯推出的一个音频驱动的真实肖像动画合成框架

AniPortrait 是腾讯推出的一个音频驱动的真实肖像动画合成框架

它能通过先进的算法,仅凭一段音频和一张静态照片,生成逼真的动态人脸动画。该技术通过捕捉音频中的语音模式、情感和节奏,并将这些信息应用到静态图片上,使之生成动态的、表情丰富的肖像动画,还能捕捉到面部的微妙表情变化,展现出高度的灵活性和多样性。此外,AniPortrait 还支持人脸重绘,添加一张照片和一段源人脸视频,就可以把照片中人物替换到源视频中。

AniPortrait 的工作原理主要分为两个阶段2:

- Audio2Lmk 阶段:利用基于 transformer 的模型从音频中提取一系列 3D 面部网格和头部姿势,然后投影到 2D 面部关键点上。

- 首先,使用预训练的 wav2vec 模型来提取音频特征,该模型能够准确识别音频中的发音和语调。

- 然后,利用这些音频特征,通过两个全连接层转换成 3D 面部网格。

- 对于头部姿势的预测,同样使用 wav2vec 网络作为骨干,但不共享权重,因为姿势与音频中的节奏和语调更为相关。这样可以捕捉到微妙的表情、嘴唇运动和与音频同步的头部运动,为后续的动画生成提供基础。

- Lmk2Video 阶段:结合强大的扩散模型和运动模块,将面部关键点序列转换为时间连贯且逼真的动态人像。

- 利用 Stable Diffusion 1.5 模型和 AniPortrait 的网络架构,生成流畅逼真的视频。

- 特别优化了姿势引导模块,采用 ControlNet 的多尺度策略,将关键点特征合并到不同的骨干模块中,以捕捉复杂的嘴唇运动。同时,引入了参考图像关键点作为额外输入,并通过 PoseGuider 的交叉注意力模块促进关键点之间的交互,提高了生成人像动画的运动精度,确保动画中的面部与原始照片保持一致,最终生成既真实又流畅的人脸动画。

ANIPORTRAIT官网:https://github.com/Zejun-Yang/AniPortrait