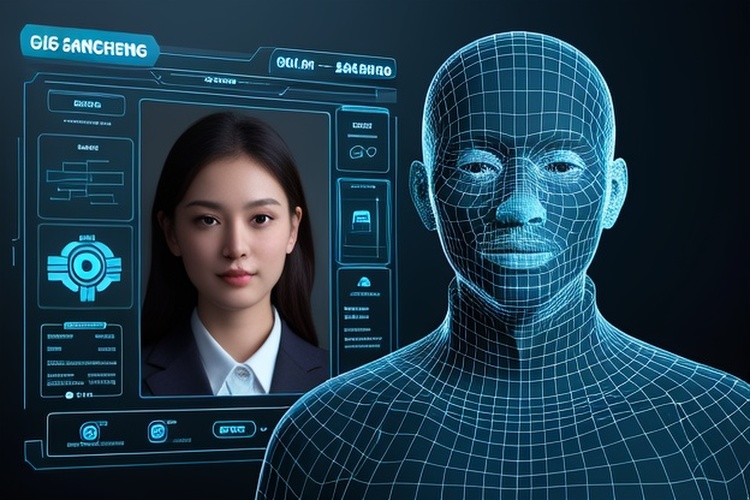

VividTalk——由南京大学、阿里巴巴、字节跳动和南开大学联合开发,实现基于单张照片和音频的说话头像视频生成

VividTalk 是由南京大学、阿里巴巴、字节跳动和南开大学联合开发的一个人工智能项目,旨在实现基于单张照片和音频的说话头像视频生成。

以下是对 VividTalk 的具体介绍1:

- 技术原理:采用两阶段通用框架。第一阶段,将音频映射到 3D 网格,通过学习非刚性表情运动和刚性头部运动来实现。对于表情运动,采用混合形状和顶点作为中间表示,以最大化模型的表示能力;对于自然头部运动,提出了一种新颖的可学习头部姿势代码本,并采用两阶段训练机制。第二阶段,利用双分支运动 – VAE 和生成器,将 3D 网格运动转化为密集运动,并逐帧合成高质量的 2D 视频。

- 功能特点

- 真实感强:生成的视频具有高质量的视觉效果,嘴唇同步和面部表情表现出色,人物看起来真实,表情和嘴型与音频完美匹配,能为观众提供沉浸式体验。

- 风格多样:支持多种风格的面部图像动画,如真实风格和卡通风格等,可以根据不同需求生成各种风格的说话头像视频。

- 语言支持广泛:能够根据各种音频信号创建说话头像视频,支持多种语言,不受语言限制。

- 应用场景

- 虚拟助手:可用于为智能手机、智能家居设备等提供更加自然、生动的语音交互服务,使智能助手的形象更加真实和具有亲和力。

- 在线教育:可以将教育内容以更加生动有趣的方式呈现给学生,例如生成虚拟教师讲解知识的视频,或者让历史人物、卡通角色等讲解相关学科知识,提高学生的学习兴趣和参与度。

- 娱乐内容制作:在影视制作、动画制作、游戏开发等领域,可以快速生成角色的说话视频,节省制作成本和时间。也可用于制作虚拟主播、虚拟偶像等的相关内容,为用户提供多样化的娱乐体验。

- 视频会议:在视频会议中,可将用户的静态头像转换为动态的说话头像,增加会议的趣味性和真实感,同时也可以通过不同的风格设置来满足用户的个性化需求。

VividTalk项目主页:https://humanaigc.github.io/vivid