OmniHuman端到端多模态条件人类视频生成框架

OmniHuman-1 展开介绍,这是一个端到端的多模态条件人体视频生成框架,在人体视频生成方面取得了显著成果。

- 研究核心:提出 OmniHuman,这是一种端到端的多模态条件人体视频生成框架。通过引入多模态运动条件混合训练策略,克服了以往端到端方法因高质量数据稀缺而面临的问题,能够基于单个图像和运动信号(音频、视频或两者结合)生成逼真的人体视频。

- 训练模态:在不同阶段,OmniHuman 涉及文本、图像、音频、姿态等多种模态参与训练。从最初的文本到视频(T2V)预训练,到后续结合多种模态进行混合条件后训练,运动相关的训练比例和模态强度有所变化,通过综合训练提升模型性能。

- 生成视频特点

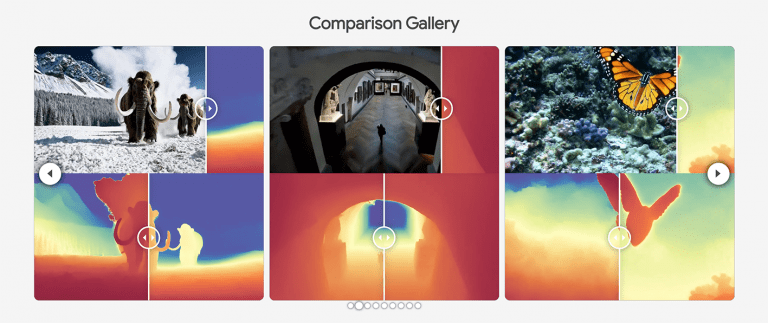

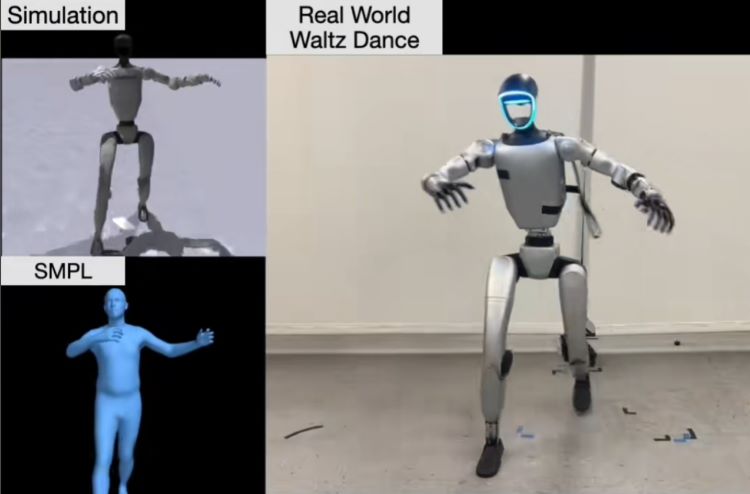

- 风格多样:支持各种视觉和音频风格,能生成任意宽高比和身体比例(肖像、半身、全身)的逼真人体视频,在运动、光照和纹理细节等方面表现出色。

- 应用场景:在唱歌场景中,可适配多种音乐风格、身体姿势和演唱形式,处理高音歌曲并呈现不同运动风格;在说话场景中,能接受任意宽高比的输入,显著改进手势处理,生成逼真结果;在输入多样性上,对卡通、人造物体、动物及挑战性姿势都能很好支持,确保运动特征与风格匹配。

- 驱动兼容性:除音频驱动外,OmniHuman 还支持视频驱动模仿特定视频动作,以及音视频联合驱动控制特定身体部位。

- 伦理声明与引用:演示所用图像和音频来自公开来源或模型生成,仅用于展示研究能力,如有侵权可联系删除。同时提供了项目的 BibTeX 引用信息,方便研究引用,还列出了团队其他相关工作。